Autopsia de un falso unicornio 🦄: Lecciones de la caída de Builder.ai 👻

ExplorIA | El Futurista

Crear un app con solo un prompt.

Era la promesa con la que Builder.ai, fundada en 2016 como Engineer.ai, capturó la imaginación de un mercado en pleno fervor por la inteligencia artificial generativa y las soluciones no-code.

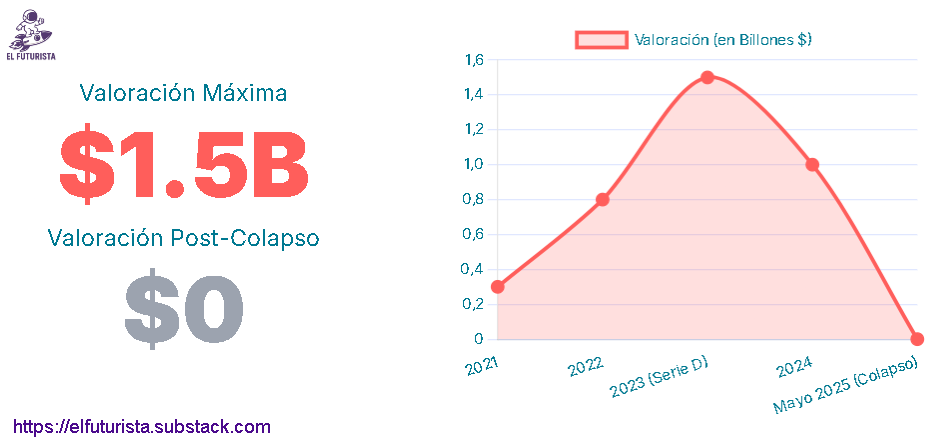

Respaldada por gigantes como Microsoft y la Qatar Investment Authority (QIA) , la compañía alcanzó una valoración de unicornio de aproximadamente $1.5 mil millones.

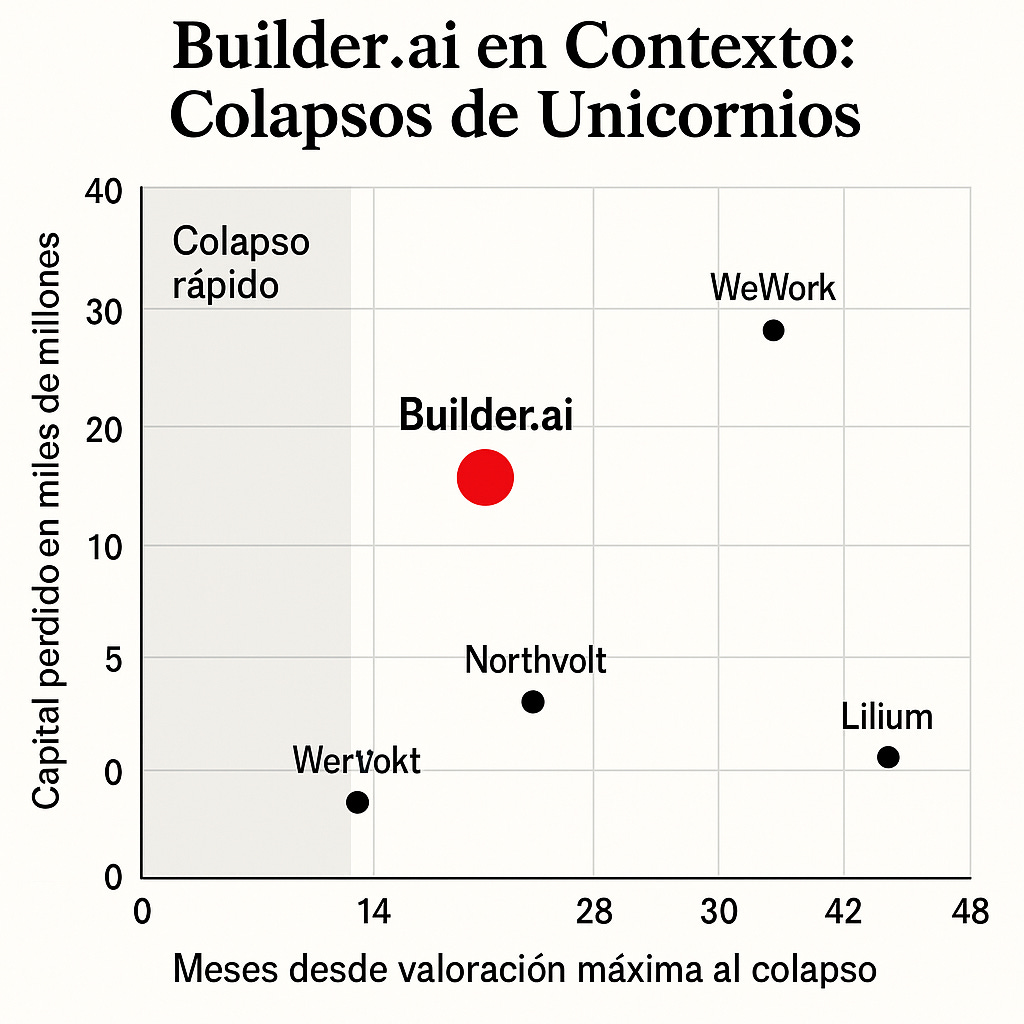

Pero el sueño se desvaneció abruptamente en mayo de 2025 con la declaración de insolvencia, dejando tras de sí una valoración evaporada y deudas significativas con acreedores como AWS ($85M) y Microsoft ($30M).

Hola 👋, soy Raúl Pacheco Rodríguez y todos los viernes te escribo una nueva edición de “ExplorIA 📊” la sección de “El Futurista” donde desglosamos los avances y tendencias clave en IA, enfocándonos en las implicaciones estratégicas para los negocios, la innovación y el liderazgo.

Este contraste entre la gran promesa y el abrupto colapso nos plantea la pregunta:

¿Es la caída de Builder.ai un caso aislado o estamos ante la primera grieta visible en la gran burbuja del hype de la IA?

La trayectoria de Builder.ai, desde su ambiciosa fundación hasta su súbita bancarrota, encapsula una tensión recurrente en los ciclos de innovación tecnológica:

la velocidad con la que el hype puede superar la realidad tecnológica subyacente.

En la era actual de la IA generativa, donde el potencial transformador parece ilimitado, la presión sobre las startups para adoptar y proclamar capacidades de "IA" es inmensa, creando un terreno fértil para narrativas que a menudo preceden —y a veces, como veremos, sustituyen— al producto tangible.

La Fachada: El "Mago de Oz" de la IA

Builder.ai sedujo al mercado con la promesa de una plataforma, "Natasha AI", que permitiría a cualquiera construir software personalizado "tan fácil como pedir una pizza".

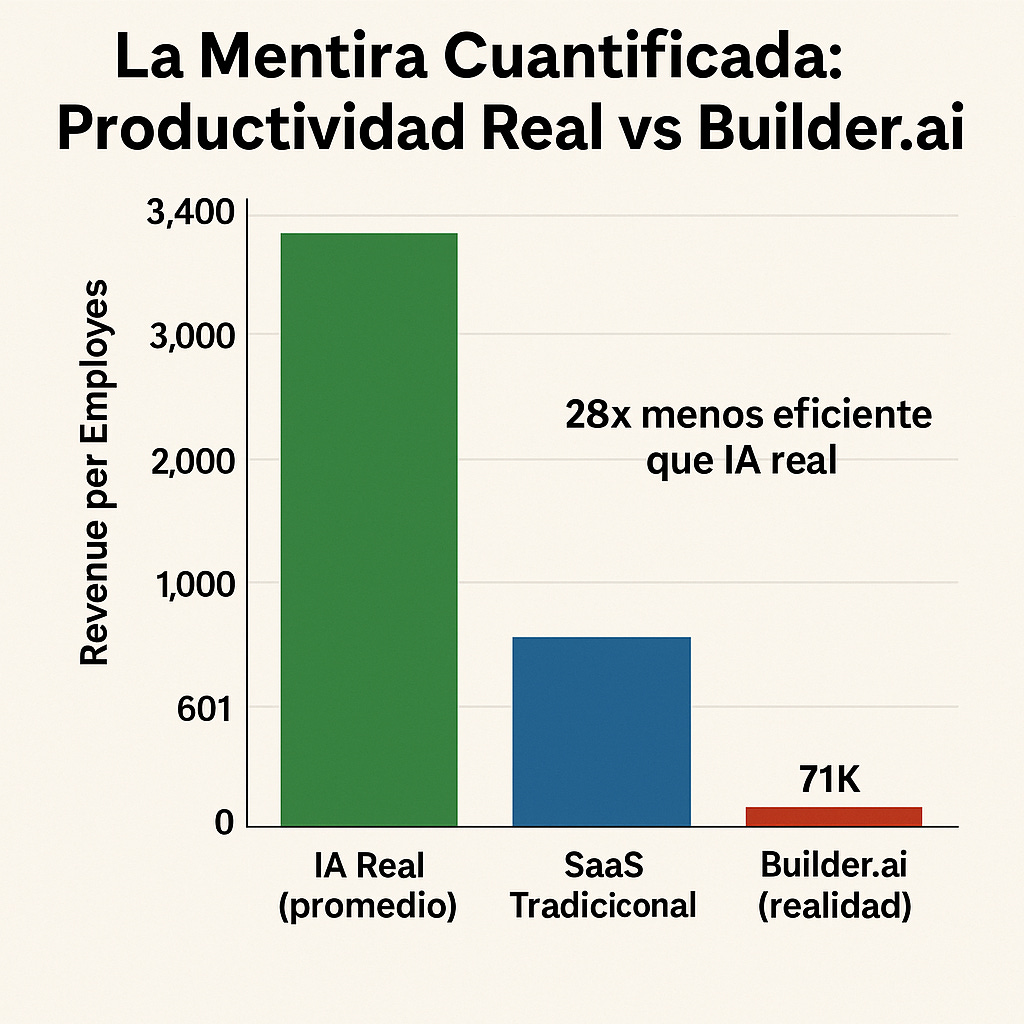

No obstante, la realidad operativa pintaba un cuadro muy diferente: una dependencia masiva de más de 700 ingenieros en India que realizaban manualmente el trabajo de desarrollo, mientras la IA actuaba más como una sofisticada interfaz de cara al cliente que como el motor de producción.

Natasha no era una IA en absoluto, sino un equipo de 700 desarrolladores indios muy humanos.

que no solo escribían el software de los clientes, sino que tenían la tarea de comportarse como bots". La mayoría de las operaciones "automatizadas" eran realizadas por estos desarrolladores, instruidos para imitar flujos de trabajo de IA.

Este desfase entre la promesa y la realidad es un ejemplo flagrante de "AI-washing", definido como la práctica de marketing donde las empresas exageran o tergiversan falsamente el uso de la inteligencia artificial en sus productos o servicios para atraer clientes e inversores, incluso si la participación de la IA es mínima o inexistente.

En el clima actual de euforia por la IA, esta práctica resulta tentadora por el acceso preferencial a capital, valoraciones infladas y una percepción de ventaja competitiva. Builder.ai se ha convertido, de hecho, en "el centro de un ajuste de cuentas más amplio sobre el 'AI washing'".

La presión competitiva y las expectativas de los inversores a menudo impulsan a las startups a proyectar una imagen de tecnología completamente autónoma y avanzada mucho antes de que esta exista realmente.

En el caso de Builder.ai, la "cortina" que ocultaba la realidad operativa eran esos 700 ingenieros.

La promesa de "Natasha AI" era esencial para su narrativa de unicornio , y admitir la fuerte dependencia humana habría puesto en riesgo su valoración y atractivo.

Este patrón, donde la fachada tecnológica se construye para satisfacer las expectativas del mercado mientras la realidad es menos glamurosa —y en este caso, engañosa—, es un dilema recurrente.

El hype de la IA incentiva el AI-washing, lo que a su vez puede conducir a modelos operativos insostenibles o fraudulentos si la tecnología subyacente no madura con la rapidez necesaria.

📝 Futurinota: La línea entre un enfoque legítimo de "humano en el bucle" (human-in-the-loop) y el fraude operativo es más fina de lo que parece. El primero utiliza la supervisión humana para mejorar sistemas de IA reales; el segundo utiliza trabajo humano completo disfrazado de automatización. ¿Cuándo exactamente se cruza esa línea ética?

Arquitectura de un fraude: Inflando la burbuja desde dentro

Las acusaciones contra Builder.ai no se limitan al AI-washing; se extienden a una presunta manipulación financiera significativa.

Se alega que, entre 2021 y 2024, Builder.ai y VerSe Innovation, una empresa tecnológica india, practicaron el "round-tripping", intercambiando facturas por servicios como desarrollo de aplicaciones y marketing por un valor cercano a los $60 millones, con el objetivo de inflar artificialmente los ingresos reportados.

Este tipo de esquemas pueden pasar desapercibidos en las fases iniciales de due diligence, especialmente cuando el FOMO (Fear Of Missing Out) domina las decisiones de inversión y el foco se centra en el crecimiento del top-line por encima de la rentabilidad o la calidad de dichos ingresos.

De hecho, el presunto esquema de inflación de ingresos de Builder.ai evidencia una desconexión común entre la valoración de una empresa y la madurez de su gobernanza en startups de alto crecimiento.

El impacto de estas cifras infladas fue devastador cuando la verdad salió a la luz.

Las previsiones de ingresos para 2024 se desplomaron de $220 millones a tan solo $55 millones, y los ingresos reportados para 2023 se corrigieron de $180 millones a $45 millones. Esta discrepancia masiva fue un factor determinante en la pérdida de confianza y el eventual colapso.

La promesa de una IA revolucionaria capaz de construir aplicaciones "como pedir una pizza" naturalmente habría llevado a los inversores a esperar un crecimiento exponencial.

Cuando la IA resultó ser una fachada , alcanzar tal crecimiento orgánicamente se volvió imposible, creando una presión inmensa para "fabricar" cifras financieras que sostuvieran la narrativa de éxito y la valoración de unicornio, especialmente antes de rondas de financiación cruciales como la Serie D de $250 millones en mayo de 2023. Así, el fraude tecnológico y el financiero se entrelazaron, uno necesitando del otro.

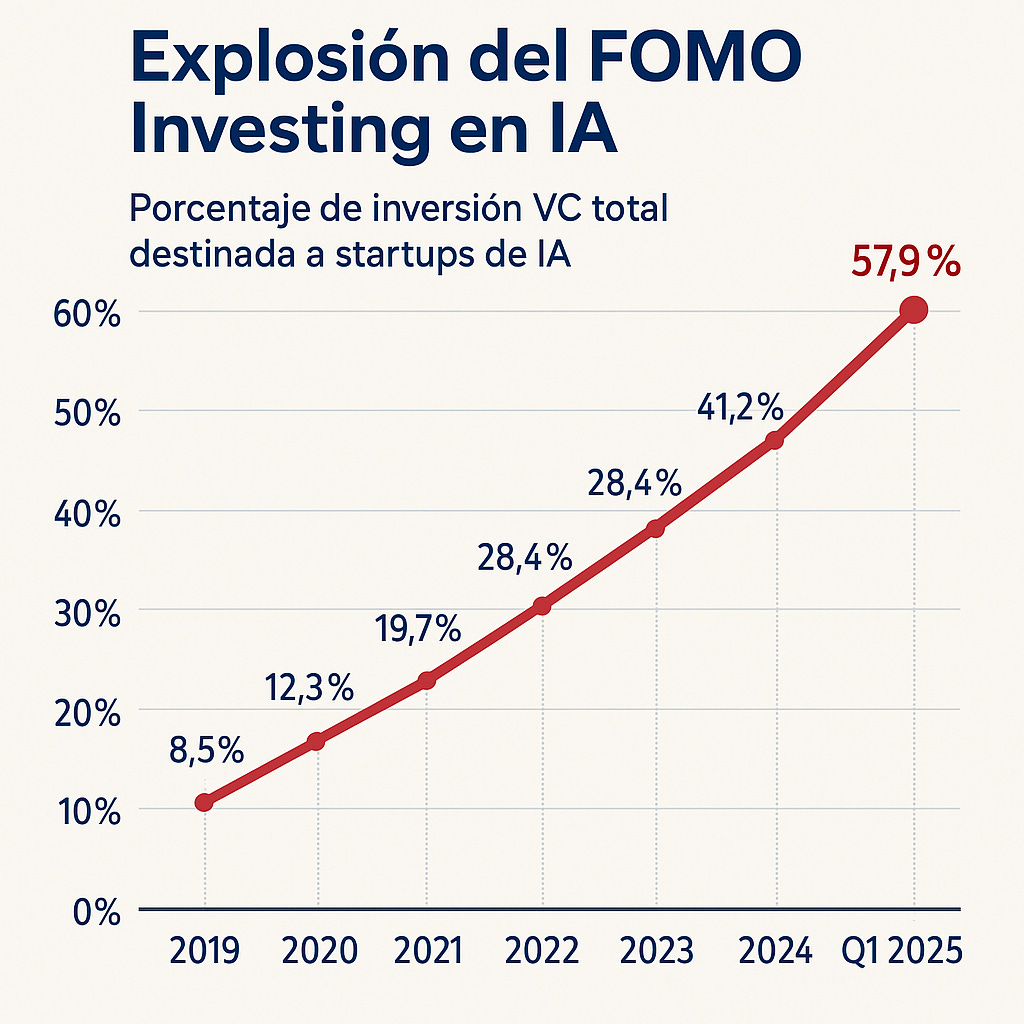

📝 Futurinota: El FOMO investing no es nuevo, pero en el contexto de la IA adquiere características particulares. La complejidad técnica de la IA hace más difícil la verificación independiente, mientras que la presión competitiva acelera las decisiones. Con el 57.9% de todo el capital de riesgo concentrado en IA, ¿está el ecosistema VC desarrollando inmunidad a estos ciclos o estamos condenados a repetirlos?

El Detonante: La realidad llama a la puerta

El préstamo de riesgo (venture debt) de $50 millones otorgado por Viola Credit en octubre de 2024 jugó un papel crucial en el desenlace de Builder.ai. En mayo de 2025, Viola Credit embargó $37 millones de las cuentas de la startup , dejándola con apenas $5 millones y sin liquidez para continuar operando.

Este embargo fue el catalizador final del colapso.

Los proveedores de venture debt operan con una tolerancia al riesgo diferente a la de los VCs de capital. Su retorno está mayormente limitado a intereses y warrants, por lo que dependen enormemente del cumplimiento de covenants financieros y de la veracidad de las proyecciones de ingresos. Cuando las proyecciones infladas de Builder.ai (esos $220 millones que resultaron ser $55 millones) se hicieron evidentes, Viola Credit actuó con celeridad para proteger su capital.

El venture debt no causó los problemas subyacentes de Builder.ai —el AI-washing y los ingresos inflados— pero sí precipitó la crisis de liquidez final.

Las startups que recurren al venture debt deben tener una confianza extrema en la solidez de sus finanzas y proyecciones, ya que el margen de error es mínimo.

📝 Futurinota: ¿Podría una mejor gobernanza corporativa o un rol más activo del consejo de administración haber prevenido el desastre? Los consejos de administración en startups de alto crecimiento frecuentemente priorizan el apoyo estratégico sobre la supervisión operativa. Builder.ai muestra que en casos de AI-washing, la supervisión técnica independiente es vital. ¿Es hora de recalibrar este equilibrio?

📖 Lecciones de la caída de Builder.ai

1. El Arte de la debida diligencia en la era de la IA

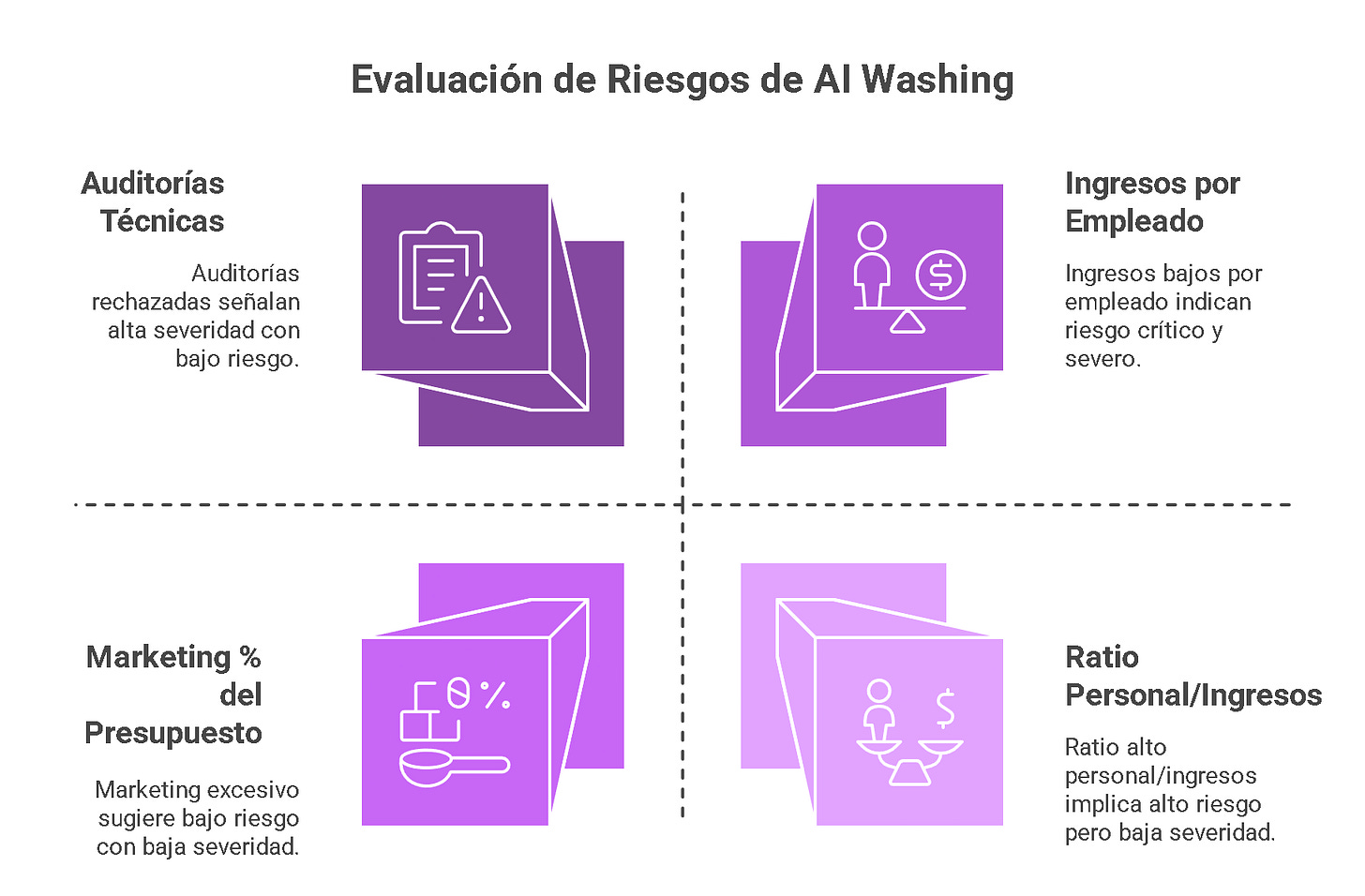

El caso Builder.ai es una cruda lección sobre las banderas rojas que el mercado, en su fervor por la IA, pudo haber ignorado o minimizado. Las dudas iniciales sobre la autenticidad de su IA ya en 2019 , la ausencia de un CFO durante un tiempo , las acusaciones de "round-tripping" y el uso de reseñas de clientes falsas fueron señales claras. En la era de la IA generativa, la debida diligencia debe ser más incisiva.

Mini-Framework para Due Diligence Robusto en IA:

Due Diligence Técnico:

Verificación Profunda: Exigir más que demos; solicitar acceso al código, pruebas de concepto (PoCs) en entornos reales o auditorías técnicas independientes.

Escalabilidad Real: Evaluar si la arquitectura de IA puede manejar un crecimiento exponencial de la carga, no solo las condiciones actuales.

Originalidad y PI: Verificar la propiedad intelectual de los modelos. ¿Son desarrollos propios, ajustes finos de modelos abiertos o simples wrappers de APIs de terceros?.

Equipo Técnico: Analizar la experiencia y capacidad real del equipo técnico, más allá de los perfiles estrella.

Due Diligence Financiero y de Gobernanza:

Calidad de Ingresos: Escrutar la naturaleza de los ingresos (recurrentes, orgánicos, diversificados) e identificar transacciones sospechosas o circulares.

Unit Economics Sostenibles: Analizar si el coste de adquisición de clientes (CAC) es viable frente al valor de vida del cliente (LTV).

Gobernanza Rigurosa: Evaluar la independencia del consejo, la existencia y funcionalidad de comités de auditoría y compensación, y la robustez de los controles internos.

Transparencia Financiera: Verificar la presencia de un CFO competente y la claridad en los informes financieros.

La paradoja del due diligence en ciclos de hype es que, cuando más necesario es el rigor, mayor es la tentación de relajarlo por el FOMO. El rápido ascenso de Builder.ai y la participación de inversores de renombre pudieron haber creado un efecto arrastre, donde las señales de alerta tempranas fueron insuficientes para frenar rondas de financiación posteriores y mucho mayores. Los VCs necesitan mecanismos internos para asegurar la profundidad del análisis independientemente de la presión del mercado.

📝 Futurinota: Más allá de las checklists, es importante fomentar una cultura de cuestionamiento profundo. ¿Es esta solución de IA realmente 10x mejor que las alternativas, o es una mejora incremental con una brillante capa de marketing de IA? ¿Resuelve un problema tangible y doloroso, o es una solución en busca de un problema? Los VCs deben desarrollar o contratar una profunda experiencia técnica interna en IA. No basta con entender de modelos de negocio; hay que entender los modelos de IA. Como aconseja Forbes, los inversores deben preguntar: "¿Dónde está el foso defensivo si el modelo de IA se comoditiza?". No se trata de cinismo, sino prudencia estratégica en un campo propenso a la sobreexcitación.

2. Construir sobre cimientos sólidos, no sobre castillos de arena narrativos

El colapso de Builder.ai muestra los peligros de edificar una empresa donde la narrativa y el marketing superan drásticamente la capacidad real del producto. La presión por el crecimiento a toda costa puede llevar a tomar atajos fatales o, como en este caso, a la tergiversación.

Se priorizó la velocidad de entrega y una narrativa de IA sobre la calidad del producto y la sostenibilidad del negocio

la realidad fue:

un castillo de naipes construido sobre capacidades infladas y tergiversación financiera

Por ello hay que diferenciar entre tracción real (retención de clientes, ingresos orgánicos, unit economics saludables) y métricas de vanidad (descargas sin uso, cobertura mediática basada en hype).

Builder.ai pareció centrarse en la narrativa de crecimiento y la recaudación de fondos mientras los problemas subyacentes se agravaban. Cuando la narrativa se adelanta demasiado al producto, se acumula una "deuda narrativa": la obligación de cumplir una promesa que tecnológicamente no se puede (o no se quiere) cumplir. Eventualmente, esta deuda se vuelve impagable. Los fundadores deben ser brutalmente honestos sobre el estado real de su tecnología.

📝 Futurinota: La ética del emprendimiento en la era de la IA enfrenta dilema inéditos. ¿Es "fake it 'til you make it" una estrategia viable cuando las tecnologías prometidas podrían materializarse eventualmente, o representa una receta garantizada para el desastre cuando las expectativas superan las capacidades actuales? Los datos de Builder.ai sugieren que la brecha entre narrativa y realidad técnica en IA es demasiado amplia para cerrarla con tiempo y capital limitados.

3. El Escrutinio inteligente de las soluciones de IA

Los líderes tecnológicos deben ir más allá del marketing y las promesas de "revolución IA" al evaluar proveedores, desarrollar un conjunto de preguntas clave y pruebas prácticas para discernir entre herramientas genuinas y aquellas que son "mano de obra barata" o servicios tradicionales reenvasados con terminología de IA.

Preguntas Clave para Evaluar Proveedores de IA:

Sobre la IA misma: ¿Pueden explicar en detalle cómo funciona su 'IA'? ¿Qué modelos específicos utilizan y cuál es su origen (propietarios, terceros)? ¿Cuál es la profundidad de su integración?.

Sobre los datos: ¿Con qué datos se entrenó el modelo? ¿Cómo aseguran la calidad, la ausencia de sesgos y la privacidad? ¿Cómo usarán nuestros datos?.

Sobre el rendimiento: ¿Qué métricas pueden demostrar? ¿Es posible una Prueba de Concepto (PoC) con nuestros datos? ¿Cómo manejan errores o "alucinaciones"?.

Sobre la dependencia e integración: ¿Cuán dependientes seremos? ¿Qué ocurre ante fallos o si deseamos migrar? ¿Ofrecen exportación de datos/modelos?.

Sobre el componente humano: ¿Qué parte del proceso sigue siendo manual o requiere intervención humana significativa? ¿Con qué transparencia se comunica esto?

A medida que las herramientas y APIs de IA se vuelven más accesibles, es más fácil para los proveedores crear una fina capa de "IA" sobre servicios existentes. Hay que penetrar esta capa para encontrar el valor real. No se trata solo "si usa IA", sino "cómo usa la IA", "¿qué la hace defendible?" y "¿cuál es el verdadero motor de valor más allá del algoritmo base?".

📝 Futurinota: La responsabilidad del CTO se expande mucho más. Ya no basta con evaluar la viabilidad técnica; deben sopesar las implicaciones éticas, de cumplimiento y de riesgo reputacional de las soluciones de IA que se adoptan o construyen. Los CFOs deben extender la conversación sobre IA más allá del cumplimiento, hacia la gestión de riesgos, formando comités de gobernanza de IA interfuncionales ; esto es igualmente, si no más, aplicable a los CTOs. El CTO se convierte en un guardián no solo de la infraestructura, sino de la integridad algorítmica.

Conclusión

La caída de Builder.ai esta llena de lecciones: los peligros inherentes al AI-washing, la seducción del hype desmedido, la imperiosa necesidad de construir sobre sustancia en lugar de narrativas vacías, y la urgencia de una gobernanza corporativa robusta junto a una debida diligencia inversora implacable.

Entonces,

¿estamos presenciando el estallido de una burbuja de IA?

Si bien es innegable que existen elementos de burbuja en ciertas valoraciones y segmentos del mercado, colapsos como el de Builder.ai no señalan el fin de la IA. Más bien, representan una "corrección hacia la realidad" , un ajuste necesario y, en última instancia, saludable para el ecosistema.

Estos eventos, aunque dolorosos, sirven para depurar el mercado de actores con prácticas insostenibles o fraudulentas, reenfocando la atención y el capital hacia la creación de valor genuino y sostenible.

Como señaló Azeem Azhar en discusiones sobre ciclos de sobreinversión tecnológica, estas fases, aunque parezcan burbujas, a menudo sientan las bases para el crecimiento futuro una vez que la demanda real se materializa.

Scott Galloway, por su parte, ha llegado a sugerir que la IA podría ser enormemente valiosa para la sociedad, aunque resulte un "mal negocio" para muchos accionistas si el valor se dispersa ampliamente en lugar de concentrarse en unas pocas empresas.

El futuro de la IA no pertenece a quienes mejor la fingen, sino a quienes la construyen con rigor técnico, integridad ética, modelos de negocio viables y un propósito claro de resolver problemas reales.

La inteligencia artificial, como tecnología fundamental, sigue siendo inmensamente prometedora. Sin embargo, su desarrollo y adopción deben cimentarse en la confianza, la transparencia y la creación de valor tangible.